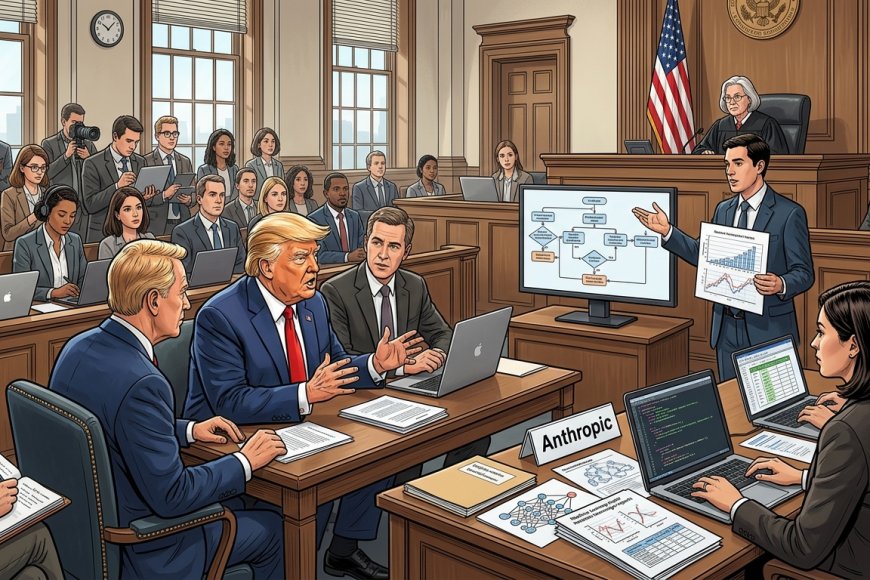

Negli ultimi mesi è emerso un confronto istituzionale tra Anthropic, azienda californiana specializzata in intelligenza artificiale guidata da Dario Amodei, e il governo degli Stati Uniti sotto la presidenza di Donald Trump. Al centro della disputa si trova l’impiego delle tecnologie di IA in ambito militare, un argomento particolarmente delicato che ha portato prima all’esclusione dell’azienda dai sistemi federali e successivamente all’avvio di un’azione legale da parte di Anthropic. Il conflitto ha avuto origine quando Anthropic ha rifiutato la richiesta del Dipartimento della Difesa degli Stati Uniti di consentire un accesso senza restrizioni ai propri modelli di intelligenza artificiale. L’azienda ha motivato il diniego con la necessità di rispettare precise clausole etiche nei contratti d’uso, imponendo limitazioni che vietano l’impiego dei suoi sistemi per attività di sorveglianza su larga scala o nello sviluppo di armamenti completamente autonomi, capaci di operare senza intervento umano diretto.

Questa posizione ha generato una frattura con l’amministrazione federale. In risposta, il presidente Trump ha firmato un ordine esecutivo che ordina a tutte le agenzie governative di interrompere immediatamente l’utilizzo delle tecnologie prodotte da Anthropic, incluso il modello di intelligenza artificiale Claude. Tramite un annuncio su Truth Social, Trump ha descritto l’azienda come “ostile dal punto di vista ideologico” e ha indicato le sue attività come una minaccia alla sicurezza nazionale. Parallelamente, il Pentagono ha avviato le procedure per inserire Anthropic in una blacklist legata alla sicurezza della catena di approvvigionamento.

Tuttavia, alcune fonti giornalistiche suggeriscono che i sistemi dell’azienda vengano ancora impiegati in contesti militari. Secondo quanto riportato dal "Wall Street Journal", il modello Claude sarebbe stato utilizzato dal United States Central Command per operazioni militari in Medio Oriente, supportando analisi in tempo reale, identificazione degli obiettivi e simulazioni strategiche prima dei raid aerei in Iran. Questo uso evidenzierebbe una discrepanza tra la linea politica della Casa Bianca e le esigenze operative delle forze armate. Uno dei principali motivi sarebbe l’elevato grado di integrazione della tecnologia di Anthropic nei sistemi militari attuali.

Alcune applicazioni impiegate dal Pentagono risulterebbero interconnesse con le piattaforme analitiche sviluppate da Palantir Technologies, progettate per elaborare grandi quantità di dati e convertirli in strategie operative. Secondo fonti interne alle forze armate, la sostituzione completa di queste tecnologie richiederebbe circa sei mesi per garantire una transizione sicura verso sistemi alternativi. Nel frattempo, il Dipartimento della Difesa sta accelerando gli sforzi per individuare nuovi fornitori nel campo dell’intelligenza artificiale.

Il segretario alla Difesa Pete Hegseth ha dichiarato che le forze armate statunitensi non possono permettersi di dipendere dalle scelte ideologiche delle aziende tecnologiche. A inserirsi in questo frangente è OpenAI, sviluppatrice di ChatGPT, che tramite il suo CEO Sam Altman ha annunciato un accordo con il Pentagono per la fornitura di modelli linguistici destinati a reti governative classificate. Pur riconoscendo alcune delle criticità etiche sollevate da Anthropic, OpenAI ha deciso di collaborare mantenendosi all'interno del quadro normativo delineato dalle autorità federali.

Il 9 marzo, Anthropic ha reagito avviando un'azione legale contro il governo degli Stati Uniti, il presidente Trump e il segretario alla Difesa Hegseth. Nel ricorso, l’azienda denuncia che l’esclusione dalle piattaforme federali e l’inserimento nella blacklist costituiscano una violazione dei principi sanciti dalla Costituzione americana. Secondo Anthropic, tali provvedimenti rappresenterebbero una rappresaglia contro le proprie dichiarazioni pubbliche sui rischi legati alla sicurezza dell’intelligenza artificiale, configurando una violazione del diritto alla libertà di espressione tutelato dal Primo Emendamento. L’azienda sostiene inoltre che esprimere preoccupazioni sulla gestione e i limiti della propria tecnologia dovrebbe rientrare pienamente nei diritti garantiti dalla Costituzione statunitense.

Nel ricorso si sostiene che l'ordine presidenziale, che impone l'interruzione delle collaborazioni con l'azienda, sia stato emesso "ultra vires", ossia oltre i limiti delle prerogative legali conferite al presidente. Inoltre, l'azienda denuncia una violazione del Quinto Emendamento, affermando che l'inserimento nella blacklist sarebbe avvenuto senza il rispetto delle garanzie procedurali previste dalla legge. Secondo quanto riportato nella causa, numerosi contratti sarebbero stati interrotti e collaborazioni future bloccate senza alcun tipo di preavviso né la possibilità di presentare una difesa formale.

Un altro elemento della contestazione riguarda la presunta violazione dell'Administrative Procedure Act, la normativa che regola le procedure da seguire per le decisioni amministrative delle agenzie federali. Anthropic sostiene che la decisione del Dipartimento della Difesa di classificare l'azienda come un rischio per la catena di approvvigionamento abbia oltrepassato l'autorità del segretario alla Difesa Hegseth, non rispettando le procedure previste dalla legge e basandosi su prove insufficienti. Questo caso segna un momento significativo nelle relazioni tra il governo federale e l’industria tecnologica della Silicon Valley.

Per la prima volta, infatti, una grande azienda tecnologica statunitense è stata formalmente designata come potenziale minaccia per la sicurezza della catena di approvvigionamento, una classificazione finora riservata principalmente ad aziende di paesi considerati avversari. Mentre Anthropic si prepara ad affrontare il contenzioso in tribunale, la vicenda mette in luce il crescente ruolo dell'intelligenza artificiale nelle strategie di sicurezza nazionale e nelle operazioni militari moderne.