Il percorso di OpenAI verso l’integrazione di contenuti espliciti all’interno di ChatGPT ha subito una nuova battuta d’arresto. Attraverso una recente dichiarazione ufficiale, l’azienda ha annunciato il secondo rinvio consecutivo del lancio dell’Adult Mode, una funzionalità concepita per permettere agli utenti maggiorenni e verificati di interagire con il chatbot senza i consueti filtri di sicurezza sui contenuti sensibili. Questa decisione segna un ulteriore scostamento rispetto alla tabella di marcia originale, delineata inizialmente dal CEO Sam Altman nell'ottobre scorso, quando la release era stata fissata per la fine del 2025 sotto il principio di garantire agli utenti adulti una maggiore autonomia.

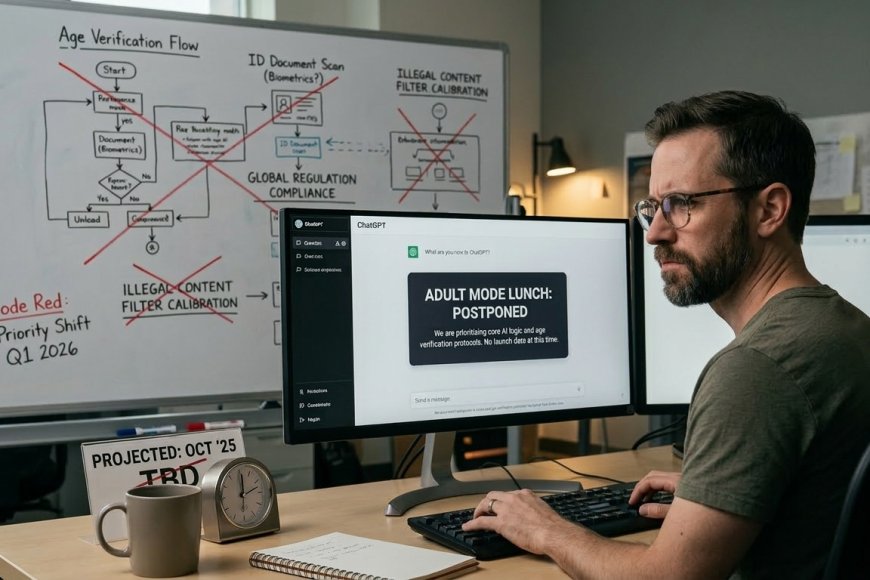

Il primo segnale di rallentamento era emerso già nel dicembre scorso, quando un memo interno aveva proclamato lo stato di "codice rosso". In quella circostanza, la dirigenza aveva scelto di dirottare le risorse verso il potenziamento delle funzioni principali del modello, spostando l'orizzonte temporale al primo trimestre del 2026. Nonostante le rassicurazioni di Fidji Simo, responsabile della divisione applicazioni, circa la necessità di affinare i sistemi di verifica dell'età, l'attuale rinvio a data da destinarsi suggerisce un cambio di rotta più profondo. OpenAI ha infatti esplicitato la volontà di privilegiare aree di sviluppo ritenute più impattanti per la massa critica degli utenti, quali l’incremento dell’intelligenza logica, la personalizzazione del comportamento dell’assistente e la sua capacità di agire in modo proattivo.

Le motivazioni dietro questo stallo non sono esclusivamente strategiche, ma affondano le radici in complesse sfide tecniche e normative. L’implementazione di un sistema di verifica dell’età che sia al contempo sicuro e rispettoso delle diverse legislazioni globali rappresenta un ostacolo non indifferente. L'azienda sta esplorando soluzioni avanzate, che spaziano dai controlli biometrici all'analisi dei documenti d'identità, fino a testare modelli di intelligenza artificiale capaci di identificare autonomamente i minori. A questa difficoltà si somma il rischio ingegneristico legato alla calibrazione del modello: il confine tra la generazione di contenuti espliciti leciti e la produzione di materiale illegale o dannoso rimane estremamente sottile, richiedendo una precisione tecnica che la società non sembra ancora pronta a garantire su larga scala.

Oltre alle barriere tecnologiche, il progetto deve fare i conti con un clima interno ed esterno segnato dalle polemiche. Alcune indiscrezioni giornalistiche hanno evidenziato come la gestione dell’Adult Mode abbia generato forti tensioni nel team di sviluppo, portando persino al licenziamento di personale che aveva sollevato dubbi etici sulla sicurezza dei minori e sul benessere mentale degli utenti. Sebbene il mercato dei contenuti generati dall'IA prometta ritorni economici elevati, OpenAI si trova costretta a muoversi con estrema cautela. L’obiettivo è evitare le critiche piovute su altri competitor del settore, cercando di bilanciare le ambizioni commerciali con la necessità di mantenere standard di sicurezza che proteggano la reputazione del brand e l'integrità del servizio.