Il 50º anniversario di Microsoft avrebbe dovuto essere una celebrazione impeccabile, luci perfette, dirigenti sul palco, parole d’ordine come “futuro”, “innovazione” e “responsabilità”. Tutto secondo copione.

Fino a quando una voce ha deciso di uscire dal silenzio.

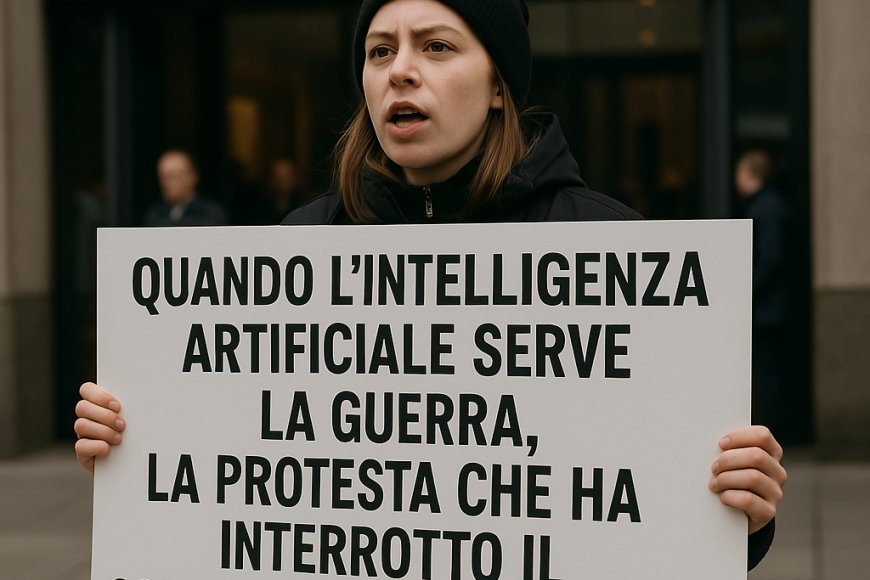

Si chiama Ibtihal Aboussad, è una dipendente dell’azienda, e ha interrotto l’evento con una protesta che non è passata inosservata.

Alzandosi in piedi di fronte al pubblico e ai vertici dell’azienda, ha accusato Microsoft di complicità nelle operazioni militari israeliane, portando all’attenzione un contratto da 133 milioni di dollari tra l’azienda e il Ministero della Difesa israeliano.

Secondo Aboussad, l’intelligenza artificiale sviluppata da Microsoft non si limita a potenziare software per ufficio o assistenti vocali. È coinvolta in tecnologie che supportano la sorveglianza militare e le operazioni di attacco nella Striscia di Gaza.

Ha parlato di una cultura aziendale che scoraggia apertamente il dissenso e oscura ogni voce critica all’interno dell’organizzazione. In altre parole: chi solleva dubbi viene isolato, o peggio, messo a tacere.

Le sue parole non sono un atto isolato, né un gesto impulsivo. Sono il sintomo di una tensione crescente all’interno del mondo tech, dove l’etica rincorre l’innovazione e spesso non la raggiunge mai.

La questione non riguarda solo Microsoft, ma l’intera filiera della tecnologia avanzata.

Chi controlla gli algoritmi? Chi ne decide le applicazioni?

E cosa succede quando queste tecnologie vengono vendute, spesso senza trasparenza, a governi o apparati militari?

La narrazione pubblica sull’intelligenza artificiale tende a mostrarla come neutra, disincarnata, al servizio del progresso. Ma ogni riga di codice ha delle implicazioni.

Ogni algoritmo è una scelta. E quando viene addestrato per riconoscere un volto da un drone o per ottimizzare una strategia d’attacco, la linea tra scienza e violenza si fa sottile.

Aboussad ha scoperchiato un nervo scoperto. La sua protesta non è stata solo un atto di coraggio personale, è un promemoria scomodo.

L’AI non è “intelligente” da sola.

È programmata, direzionata, inserita in sistemi di potere e controllo. E può diventare parte integrante di una macchina bellica tanto quanto lo è un’arma tradizionale.

In un’epoca in cui le aziende tech vestono i panni di demiurghi digitali, celebrare anniversari senza fare i conti con il lato oscuro dell’innovazione è un lusso che non possiamo più permetterci.