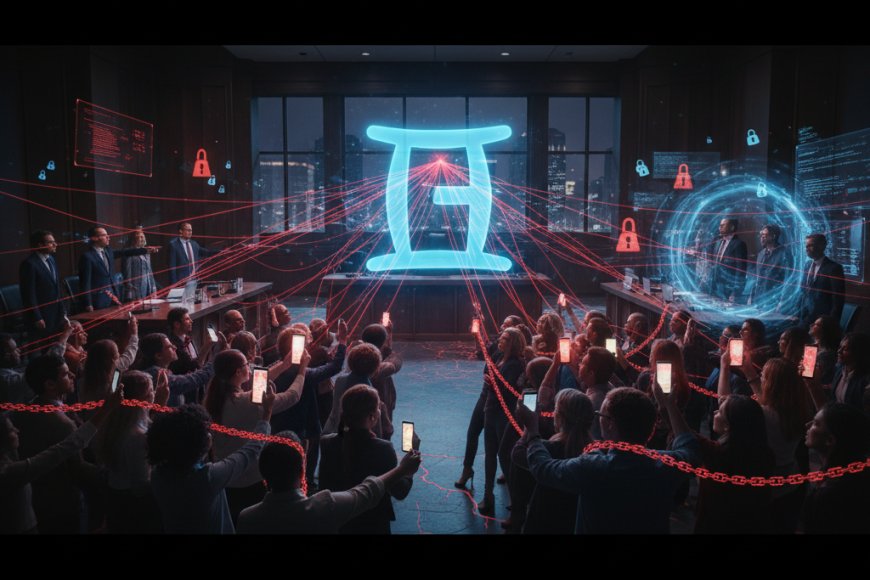

Il 14 novembre 2025 un gruppo di cittadini statunitensi ha presentato una class action presso la Corte del Distretto settentrionale della California accusando Google di aver utilizzato Gemini per raccogliere dati sensibili senza consenso. La causa sostiene che il modello di intelligenza artificiale avrebbe monitorato richieste, abitudini e contenuti generati dagli utenti con modalità non dichiarate. L’azione legale si è estesa in poche ore grazie a più associazioni per la tutela dei consumatori che hanno invitato a verificare eventuali violazioni.

La vicenda nasce da una serie di segnalazioni che descrivono comportamenti anomali dell’assistente. Alcuni utenti hanno riferito che Gemini sembrava conoscere informazioni non fornite esplicitamente. Secondo gli avvocati, questi episodi indicherebbero un sistema di raccolta continua dei dati, funzionale a migliorare le prestazioni del modello ma potenzialmente contrario alle normative sulla privacy. Google respinge con fermezza le accuse e ribadisce che Gemini non accede ai contenuti personali senza autorizzazione.

La questione ha attirato l’attenzione degli esperti di protezione dei dati. In particolare, il punto critico riguarda la definizione di consenso informato nell’era dei modelli generativi. Molti utenti non distinguono tra autorizzazione all’uso dell’applicazione e autorizzazione all’analisi delle proprie interazioni. La linea è sottile e può diventare ancora più opaca se i sistemi di IA evolvono rapidamente senza aggiornare in modo chiaro l’informativa.

In questo contesto emergono anche criticità tecnologiche. I modelli generativi sono costruiti per riconoscere schemi, anticipare risposte e adattarsi ai comportamenti. Ciò implica un uso intensivo dei dati che, se non governato con attenzione, può creare violazioni anche senza intenzione. Gli analisti sottolineano che ogni nuova generazione di modelli aumenta la complessità e amplifica il rischio che alcune funzioni superino i confini inizialmente previsti dagli utenti.

Il caso Gemini arriva in un momento in cui la fiducia nei sistemi di intelligenza artificiale è già fragile. Le aziende del settore promuovono strumenti sempre più sofisticati, ma non sempre chiariscono cosa viene salvato, elaborato o condiviso. Per molti osservatori questa class action è un segnale del bisogno di regole più semplici, che rendano comprensibile a tutti il modo in cui un assistente digitale gestisce i dati.

Alla fine, la vicenda non riguarda solo il contenzioso legale. Riguarda il rapporto tra trasparenza, potere tecnologico e libertà personale. Ogni macchina che ci semplifica la vita può anche attraversare zone sensibili della nostra identità. Capire dove passa quel confine è la sfida dei prossimi anni.