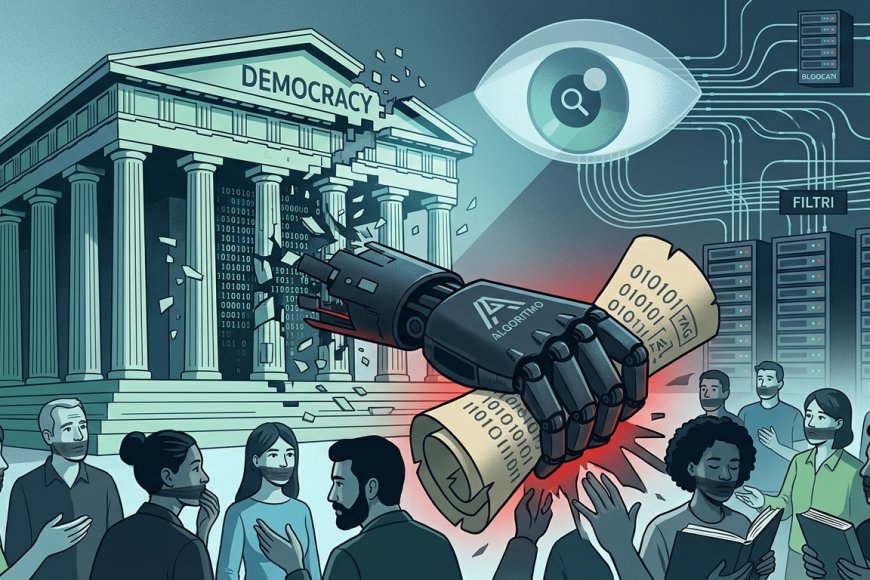

L’articolo di approfondimento culturale svanisce nel nulla digitale. Non perché inciti all’odio, non perché diffonda disinformazione, ma per un’etichetta semantica. Un caso vissuto da questo giornale è quello che è accaduto con il mio articolo "La democrazia sintetica", pubblicato il 29 aprile 2026, che è stato bloccato dalle sponsorizzate di Facebook ed Instagram per il fatto che contenga la parola “democrazia” nel titolo. Questo è il sintomo di una patologia sistemica: l'algoritmo di Meta ha deciso che parlare di democrazia è, di per sé, un atto troppo "sensibile" per essere diffuso. È il paradosso estremo del nostro tempo: un’intelligenza artificiale censura un’analisi sull'intelligenza artificiale solo perché non riesce a distinguerla dalla propaganda politica.

Negli uffici di Menlo Park, la complessità del pensiero umano è stata ridotta a un elenco di "tag" proibiti. Dal 6 ottobre 2025, Meta ha imposto un blocco drastico alle inserzioni su temi politici, elettorali e sociali in tutta l'Unione Europea. Non si tratta solo di fermare i partiti, ma di silenziare chiunque tratti argomenti che Meta definisce "sensibili": sanità, diritti civili, ambiente e, appunto, la struttura stessa del dibattito democratico.

Il machine learning di Meta esamina non solo il testo, ma anche le immagini, il contesto e persino la landing page di destinazione. Se l'algoritmo intercetta una parola trigger, la mannaia cade inesorabile. Lo ammette persino Nick Clegg, responsabile degli Affari Globali di Meta: l'azienda riconosce di aver rimosso troppi contenuti leciti, ammettendo che i tassi di errore nella moderazione automatizzata sono ancora "eccessivamente elevati". Eppure, nonostante la consapevolezza di queste "allucinazioni" algoritmiche, la scelta strategica è chiara: preferire il "falso positivo" (bloccare troppo) alla responsabilità editoriale.

Questa deriva è una risposta distorta alle nuove normative europee come il Digital Services Act (DSA) e il regolamento TTPA (Transparency and Targeting of Political Advertising). Mentre il legislatore europeo punta a una maggiore trasparenza e alla mitigazione dei rischi sistemici per la libertà di informazione, le Big Tech rispondono con il disimpegno: anziché investire in una moderazione umana capace di discernimento, chiudono i rubinetti del dibattito pubblico.

Il rischio non è solo tecnico, è esistenziale. Se per sponsorizzare e far circolare un’analisi culturale che contiene la parola "democrazia" o "diritti umani" si viene schedati come soggetti politici o, peggio, silenziati, che tipo di agorà stiamo costruendo? Stiamo scivolando verso una democrazia filtrata alla base, dove la circolazione delle idee è subordinata alla "tranquillità" di un algoritmo che non vuole grane legali.

Le organizzazioni non profit e gli editori indipendenti sono le prime vittime di questo "filtro semantico". Un contenuto che denuncia una carenza del sistema sanitario o analizza una riforma della giustizia viene equiparato alla propaganda elettorale, rendendo di fatto impossibile la sensibilizzazione su larga scala. È una riduzione del pensiero critico a rumore di fondo che l'algoritmo deve eliminare per mantenere pulita la piattaforma.

Non possiamo permettere che il perimetro della nostra libertà d'espressione sia tracciato da strumenti che Clegg stesso definisce "ancora imperfetti e immaturi". La sorveglianza pubblica invocata dal DSA dovrebbe servire a proteggere i diritti fondamentali, non a incoraggiare la censura preventiva per eccesso di prudenza.

In un panorama mondiale dove la disinformazione dilaga, tra fake news, deepfake e ai massimi storici – questo anche per colpa dell'utilizzo permissivo e sfrenato del mezzo IA –, le aziende social come Meta, che ormai nella percezione comune sono “anche” mezzi di informazione, delegano alla stessa IA l’onere di moderare suddetti contenuti. Qui risiede il paradosso di questa tecnologia: infatti la “pigrizia algoritmica” di questi sistemi risiede nel ridurre tutti i contenuti di un post e di un articolo alla presenza o no di specifici termini, e non alla comprensione profonda di un contenuto – comprensione che tra l'altro non è possibile da parte di una macchina.

È necessaria una chiamata all'azione per una moderazione più umana e consapevole. Le piattaforme devono smettere di nascondersi dietro la "complessità inattuabile" dei regolamenti per giustificare il silenzio imposto alle voci indipendenti. Distinguere tra propaganda manipolatoria e analisi giornalistica o accademica non è un optional: è il requisito minimo per abitare lo spazio digitale. Senza questa distinzione, l'algoritmo continuerà ad avere paura della democrazia, finendo per soffocarla nel tentativo di "proteggerla".