OpenAI e MIT Media Lab hanno condotto uno studio sul rapporto tra esseri umani e chatbot; il risultato è stato la constatazione di una dipendenza di carattere emotivo.

Open AI ha dichiarato i numeri della gente che usa ChatGPT: oltre 400 milioni di utenti a settimana. Proprio da questi numeri è nata l'idea della collaborazione con MIT Media Lab, per svolgere un'indagine sugli effetti di questa interazione con i chatbot di intelligenza artificiale.

RISPOSTA DELL'IA ALLA DIFFERENZA DI GENERE

Durante l'utilizzo del chatbot, della durata di un mese, sono state rilevate differenze sostanziali nella risposta all'utilizzo di ChatGPT: uomini e donne reagiscono in modi diversi. Si è notato, per esempio, che le utenti femmine erano meno propense a socializzare. A fine studio, addirittura, i partecipanti che hanno interagito con la chat vocale di ChatGPT, provavano una sensazione di solitudine e vera e propria dipendenza emotiva nei riguardi del chatbot.

E questo è soltanto uno studio che ha visto coinvolte delle persone per un periodo determinato. Immaginiamo fin dove possiamo spingerci utilizzandolo ogni giorno per svariate ore. Gli psicologi hanno dato l'allarme, adesso sta a noi ascoltarlo.

Per presevare la privacy, lo studio è stato condotto su larga scala, analizzando oltre 4 milioni di interazioni utente/macchina. Sono stati sondati oltre 4.076 utenti in merito alla percezione di ChatGPT, e successivamente, per capire il rapporto col benessere emotivo, è stato istituito un comitato di revisione istituzionale su circa 1.000 partecipanti durante il mese di studio. Questo a dimostrazione del fatto che si è data reale importanza allo studio in questione per capire fin dove porta un utilizzo di chatbot condotto in modi non proprio convenzionali.

RISCHIO DI DIPENDENZA DA CHATBOT: RELAZIONE E SOLITUDINE

Se andiamo a ritroso fino al 2023, i ricercatori del MIT Media Lab avevano già scoperto che i chatbot tendevano a rispecchiare i sentimenti emotivi dei messaggi che ricevevano come input, restituendo di buon grado output positivi o negativi, possiamo anche dire felici o tristi, in base alla situazione in cui si trovavano. D'altronde se chiediamo qualcosa al chatbot inserendo nella nostra domanda un "per favore", il chatbot ci restituirà un feedback decisamente positivo.

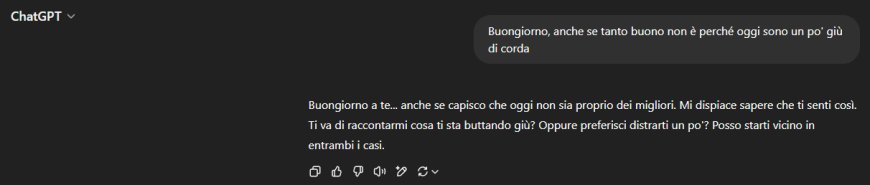

Bisogna fare una piccola precisazione, onde evitare fraintendimenti. I chatbot come ChatGPT non sono dei companion, ma sono atti alla produttività. Che significa questo? Che non sono progettati per fornire supporto emotivo.

Come possiamo notare, sembra quasi un amico con cui ci stiamo confidando. Inutile precisare che la cosa possa diventare rischiosa per gente in difficoltà emotive e che ha bisogno di parlare con qualcuno in un momento in sui si sente sola...e tutto ciò è a portata di mano sul nostro telefono e sicuramente più accessibile del cercare qualcuno che ha voglia di ascoltarci.

Al termine dello studio, gli utenti sono stati sottoposti a un questionario che verteva sulla loro esperienza col chatbot di OpenAI. Ne è risultato che gli utenti che avevano "legato emotivamente" col chatbot, erano più propensi alla solitudine e più dipendenti da esso.

Il team ha fatto presente che tutto è stato fatto a campione, probabilmente alcuni eventi non sono stati registrati o addirittura alcuni non hanno usato l'emotività nell'interazione con la macchina.

Sono stati analizzati oltre 300.000 messaggi durante l'indagine sull'utilizzo del chatbot. I modi di interazione cambiavano a seconda che si usasse o meno la modalità vocale. I chatbot in modalità vocale, si è notato, mitigavano la solitudine ma solo inizialmente; vantaggio che svaniva con un utilizzo elevato e con un voce neutra in risposta agli input.

In conclusione, sarebbe opportuno prestare attenzione perché il confine tracciato è molto sottile, e menti labili sono a rischio emotivo ogni giorno di più.