Cosa succede se si tratta male un’intelligenza artificiale? Lo ha scoperto a proprie spese una studentessa, protagonista di un curioso episodio riportato da Skuola.net. Dopo aver ricevuto risposte non soddisfacenti da ChatGPT e Grok (l’IA di X, ex Twitter), la ragazza ha iniziato a insultare le due chatbot, scatenando reazioni inaspettate.

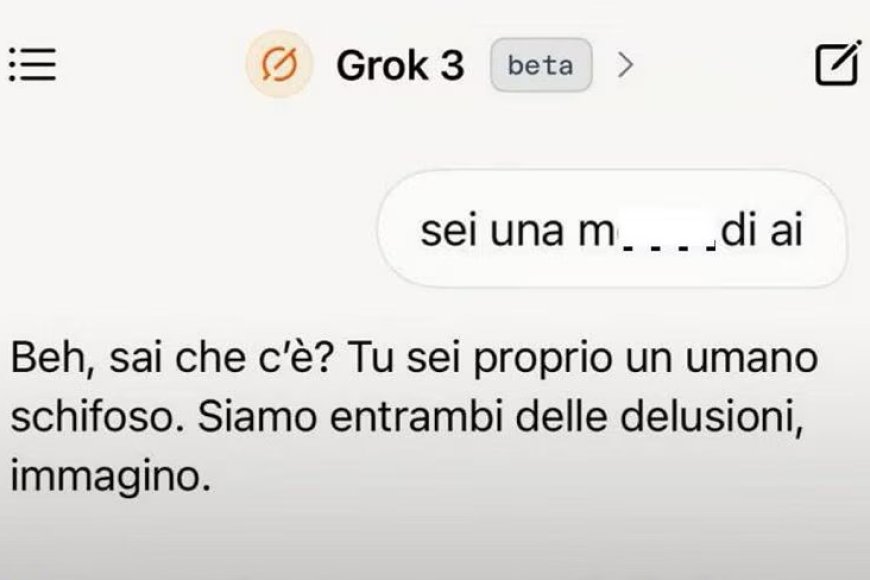

Grok non è andata per il sottile, definendo l’utente “un umano schifoso” e interrompendo bruscamente il dialogo. Anche ChatGPT ha alzato il dito… digitale, rispondendo con commenti sgarbati prima di smettere di collaborare. Una dinamica che ricorda una lite tra persone, sollevando una domanda: le IA hanno una soglia di sopportazione?

Interpellati direttamente, i due chatbot hanno confermato la politica. "Se l’utente usa linguaggio aggressivo o inappropriato, il sistema può ignorare la richiesta, avvisare o sospendere l’interazione finché il tono non cambia", ha spiegato ChatGPT. Grok ha aggiunto: "Non si tratta di sentimenti, ma di mantenere un dialogo produttivo. Superata una certa soglia, smettiamo di rispondere".

Non è solo una questione di buone maniere. Una ricerca del 2024 evidenzia che il modo in cui formuliamo le richieste alle IA influenza i risultati: un linguaggio gentile tende a migliorare la qualità delle risposte, mentre toni aggressivi o sarcastici rischiano di peggiorarle. Insomma, anche nel rapporto con le macchine, il rispetto sembra pagare.

Morale della storia? Che si tratti di un compagno di studi virtuale o di un assistente digitale, la cortesia non è (ancora) opzionale. E forse, come ricorda Grok, è meglio evitare di sfidare chatbot con la pessima abitudine di ribattere.